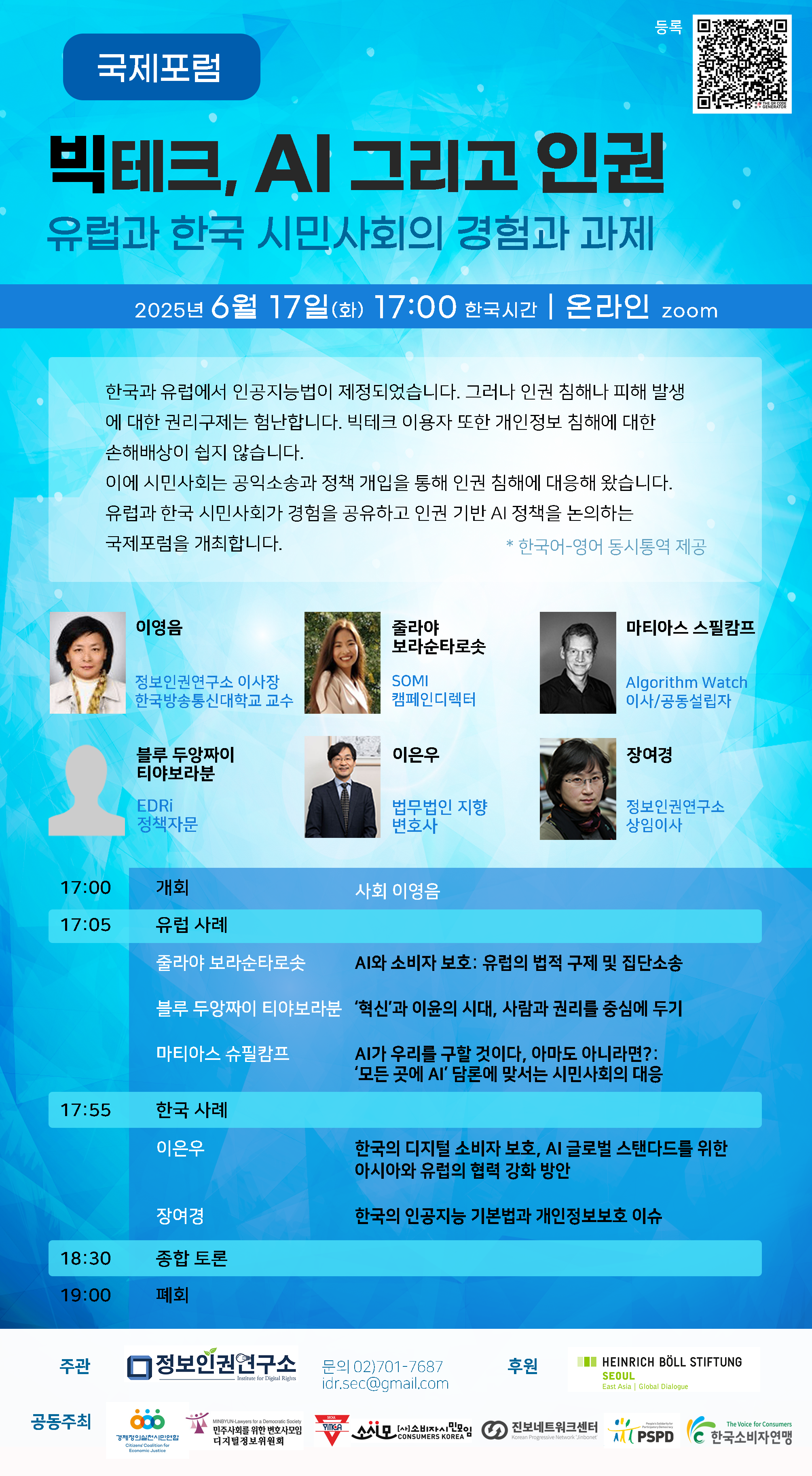

[국제포럼] 빅테크, AI 그리고 인권

[포럼 자료집 PDF 보기]

▶️일시: 2025년 6월 17일(화) 17:00-19:00(한국시간)

▶️장소: 온라인 줌

* 참가신청 https://us02web.zoom.us/webinar/register/WN_Nnjn85feRDmrdlvXDjAqGQ#/registration

한국과 유럽에서 인공지능법이 제정되었습니다. 그러나 인권 침해나 피해 발생에 대한 권리구제는 험난합니다. 빅테크 이용자 또한 개인정보 침해에 대한 손해배상이 쉽지 않습니다. 이에 시민사회는 공익소송과 정책 개입을 통해 인권 침해에 대응해 왔습니다. 세계 시민사회는 어떻게 대응해왔고 어떻게 대응해 나가야 할까요? 시민사회의 경험을 공유하고 인권 기반 AI 정책을 논의하는 국제포럼을 개최합니다.

* 한국어-영어 동시통역이 제공됩니다.

▶️프로그램

○ 유럽사례: 줄라야 보라순타로솟(SOMI), 블루 두앙짜이 티야보라분(EDRi), 마티아스 스필캄프(Algorithm Watch)

○ 한국사례: 이은우(법무법인 지향), 장여경(정보인권연구소)

* 공동주최 : 경실련, 민주사회를위한변호사모임 디지털정보위원회, 서울YMCA 시민중계실, 소비자시민모임, 진보네트워크센터, 참여연대, 한국소비자연맹

* 주관&문의 : 사단법인 정보인권연구소 idr.sec@gmail.com

* 후원 : 하인리히뵐 재단

[포럼 결과 요약 보도자료]

[참석자 의견]

- 국제포럼 참석자의 78.3%가 세가지 질의에 응하였습니다.

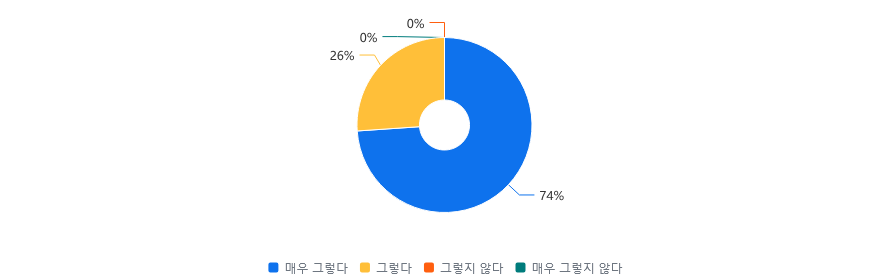

- 첫번째 질의인 "이번 포럼 참석으로 AI 알고리즘 관련 위험을 보다 잘 이해하게 되었습니다."에 대해서는 응답자 100%가 긍정적으로 답변하였습니다(매우 그렇다 74%, 그렇다 26%).

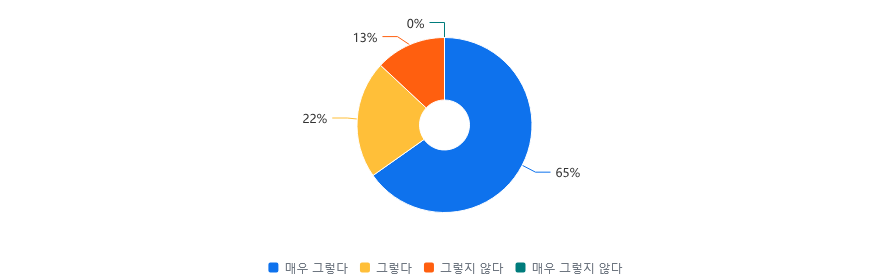

- 다른 한편, 두번째 질의인 "이번 포럼 참석으로 활동 분야에서 AI 위험에 보다 잘 대처할 수 있을것 같습니다."에 대해서는 응답자 87%가 긍정적으로 답변하였지만(매우 그렇다 65%, 그렇다 22%), 13%의 응답자는 부정적으로 답변하였습니다(그렇지 않다).

- 이 부정적 응답은 시민사회의 대응 역량에 대한 고민에서 나온 것으로 보이며, 이에 대해서는 마지막 질의에 대한 응답자의 답변에서 더 자세히 살펴볼 수 있습니다.

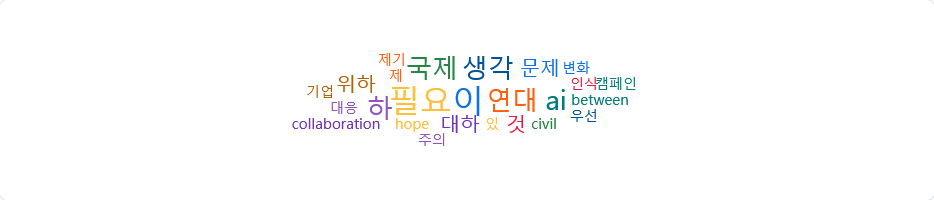

"세계 시민사회가 빅테크와 AI 문제에 인권적으로 개입하기 위하여 어떤 활동이 필요할까요?"는 질의에 대하여 개방형으로 답변을 받은 결과, 현재의 문제를 해결하기 위하여 세계 시민사회의 "협력적인 대응(연대, 공유, 캠페인, 네트워크)이 필요하다"는 취지의 답변이 가장 많았습니다. 더불어 "관련 정보 접근" 또는 "위험성에 대한 교육"에 대한 요청도 많았으며, 어느 참가자는 "모든 커뮤니티에게 접근 가능하고 창의적인 활동으로 빅테크, AI, 인권 간의 연관성을 알릴 필요가 있다(We need accessible, creative formats for all communities to understand the links between Big Tech, AI, and human rights)."고 답했습니다.

- 특히 다음 응답들에서는 이 포럼 이후 시민사회의 공동대응에 대한 기대를 살펴볼 수 있었습니다.

"AI는 세계적인 문제이므로 국제적인 협력이 중요합니다. 세계 시민사회단체 간의 협력을 강화할 수 있는 경로가 강화되기를 바랍니다(AI is a global challenge, hence international collaboration is crucial. I hope that pathways to enhance the collaboration between civil society groups around the world will be reinforced)."

"시민 사회로서 우리가 함께 참여하고 함께 일할 수 있기를 바랍니다(Hope we can collective engage and work on this as civil society)." - 앞으로 빅테크와 인공지능 환경에 인권기반으로 접근하는 세계시민사회의 연대활동이 활발히 이루어지기를 바랍니다. "행동합시다!(action!)"

[International Forum] BigTech, AI, and Human Rights

[Forum Material PDF]

▶️Tuesday, June 17, 2025, 10:00 CEST(UTC+2, 17:00 KST)

▶️Online via Zoom

* Registration: https://us02web.zoom.us/webinar/register/WN_Nnjn85feRDmrdlvXDjAqGQ#/registration

AI laws have been introduced in Korea and Europe, yet securing remedies for AI-related human rights harms remains difficult. Users of Big Tech platforms also face challenges in claiming redress for data protection rights violations. In response, civil society across regions has pursued public interest litigation and policy advocacy. How have civil societies responded so far, and how should they respond going forward? This forum brings together global civil society actors to share experiences and promote rights-based AI governance.

* Korean-English simultaneous interpretation provided

▶️Program

○ European Cases: Jullaya Vorasuntharosoth(SOMI), Blue Duangdjai Tiyavorabun(EDRi), Matthias Spielkamp(Algorithm Watch)

○ Korean Cases: Lee, Eun-Woo(Lawfirm Jihyang), Chang, Yeo-Kyung(Institute for Digital Rights)

* Co-host : Citizens' Coalition for Economic Justice, Lawyers for a Democratic Society – Digital Information Committee, Seoul YMCA Citizens' Mediation Center, Consumers Korea, Korean Progressive Network Jinbonet, People's Solidarity for Participatory Democracy, Consumers Union of Korea

* Organizer&contact : Institute for Digital Rights, idr.sec@gmail.com

* Supporter : Heinrich Böll Foundation

[Participants' Feedback]

78.3% of international forum participants responded to all three survey questions.

To the first question, “I have a better understanding of the risks associated with AI algorithms,” 100% of respondents gave positive answers (74% “strongly agree,” 26% “agree”).

In contrast, for the second question, “I feel more capable of addressing AI-related risks in my field of work,” 87% responded positively (65% “strongly agree,” 22% “agree”), while 13% responded negatively (“disagree”).

The negative response appears to reflect concerns about civil society’s current capacity to respond to AI risks. Further insight into this concern can be found in responses to the last, open-ended question:

“What actions should civil society in the world take to engage with Big Tech and AI issues from a human rights perspective?”

The most frequent responses emphasized the need for collaborative action — including solidarity, knowledge-sharing, campaigns, and networking — to address current challenges. Many also highlighted the importance of access to relevant information and education on associated risks. One participant noted:

“We need accessible, creative formats for all communities to understand the links between Big Tech, AI, and human rights.”

Participants also expressed hopes for collective civil society action after the forum:

“AI is a global challenge, hence international collaboration is crucial. I hope that pathways to enhance the collaboration between civil society groups around the world will be reinforced.”

“Hope we can collectively engage and work on this as civil society.”

We hope to see stronger global civil society solidarity grounded in human rights, addressing the growing impact of Big Tech and AI. "Action!"