2025-06-11

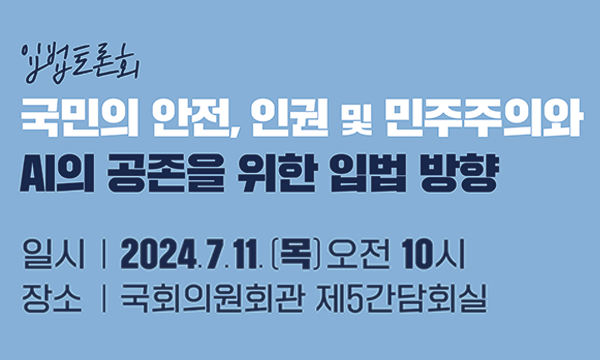

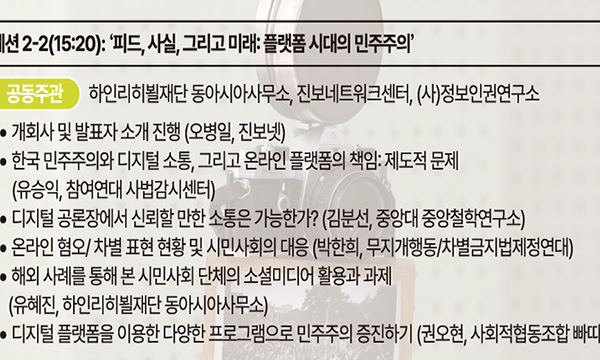

[국제포럼] 피드, 사실, 그리고 미래: 플랫폼 시대의 민주주의

정보인권연구소는 민주화운동기념사업회의 <2025 KDF 글로벌포럼>에서 하인리히 뵐 재단 동아시아 사무소, 진보네트워크센터와 함께 <피드, 사실, 그리고…

2025-05-23

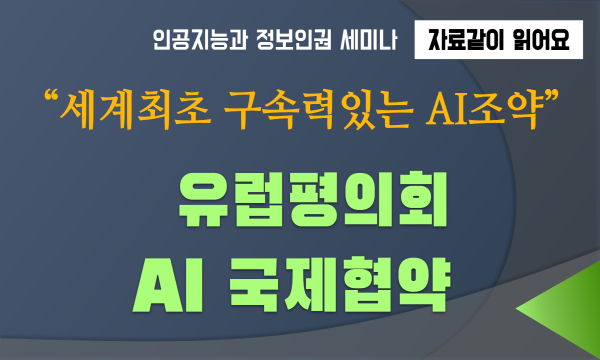

[세미나] 유럽평의회 AI 국제협약

https://youtu.be/RKclH8x6zjs 유럽평의회 AI국제협약 (번역) 2024년 9월 5일 유럽평의회는 을 공개했습니다. 이 협약은 인공지능 분야에서 법적…

2025-04-14

[신고/기자간담회/캠페인] 내 일상은 AI 학습용이 아니다

– 이용자 개인정보를 불법적으로 AI 학습 목적으로 처리한 메타, X에 대한 개인정보위 신고 - 개인정보위는…

2025-03-19

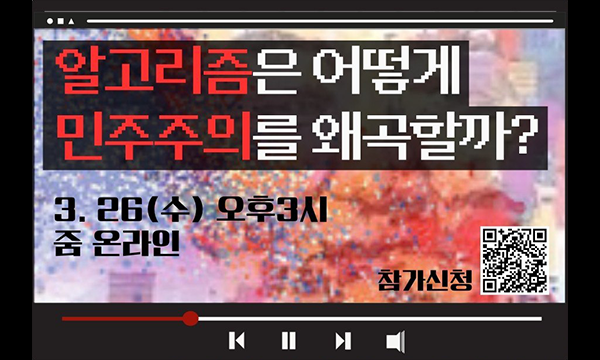

[웨비나] 알고리즘은 어떻게 민주주의를 왜곡하는가

행사 내용 12.3 계엄을 세계 최초의 알고리즘 계엄이라고 합니다. 계엄에도 불구하고 오히려 윤석열을 지지하는…

2025-03-17

[강연] 인공지능(에 의한) 의사결정과 인권

https://www.youtube.com/watch?v=tUMoKu5MU_Y 정보인권연구소 창립 10주년 후원의 밤 키노트 스피치 "인공지능(에 의한) 의사결정과 인권" 일시 :…

2025-03-01

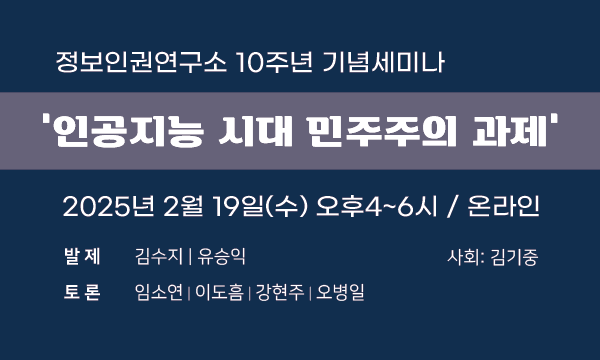

[세미나] 인공지능 시대 민주주의 과제

https://www.youtube.com/watch?v=XCVw5-Q0uQ0 12. 3 비상계엄은 우리 사회 민주주의가 아직 가야 할 길이 멀다는 사실을 확인했던 사건이었습니다.…

2025-01-31

[시민사회포럼] AI 민주주의와 영향을 받는 사람의 권리

제2회 시민사회포럼 “AI 민주주의와 영향을 받는 사람의 권리” 개최 2024년 12월 AI 기본법이 국회를 통과했습니다.…

2024-10-14

[세미나] 유럽 EDPS 설명가능한 인공지능 XAI

https://youtu.be/vBZMIYNMnYc 유럽 EDPS 설명가능한 인공지능 XAI (번역) 설명가능한 인공지능이란 무엇이고 어떻게 구현할 수 있을까요? 2023년…

2024-10-01

[세미나] 미국 NIST 설명가능 인공지능 4가지 원칙

https://youtu.be/rpX88rVRRuw 미국 NIST 설명가능한 인공지능 4가지원칙 (번역) 미국 상무부 산하 국립표준기술연구소(NIST)는 2021년 9월 <설명가능한 인공지능의…

2024-09-23

인권단체를 위한 디지털 보안 워크숍

1차 <디지털 보안 워크숍> 해킹과 보안사고 리스크가 커지고 있는 지금! 디지털 보안 필수 개념을 알아보고…

2024-09-10

[인공지능과 정보인권 세미나] 자료 같이 읽어요

디지털 플랫폼과 인공지능이 우리의 삶에 갈수록 깊이 관여하고 있습니다. 스마트한 디지털 기술의 편의성은 모든 시민이…

2024-09-05

[국회토론회] 지속되는 통신사찰, 진단과 해법

통비법 체계로 통합해 통신이용자정보, 통신사실확인자료 수준으로 보호해야 제공요건 강화와 법원 허가제, 사후구제와 파기 규정 등…

2024-08-01

[세미나] 범용 AI, 통제 가능할까?

https://www.youtube.com/watch?v=ajqIICcO5IA 웨비나 PDF 자료집 받기 중간보고서 원문(영문) 받기 법무법인 지향 X 진보네트워크센터 X 정보인권연구소 웨비나…